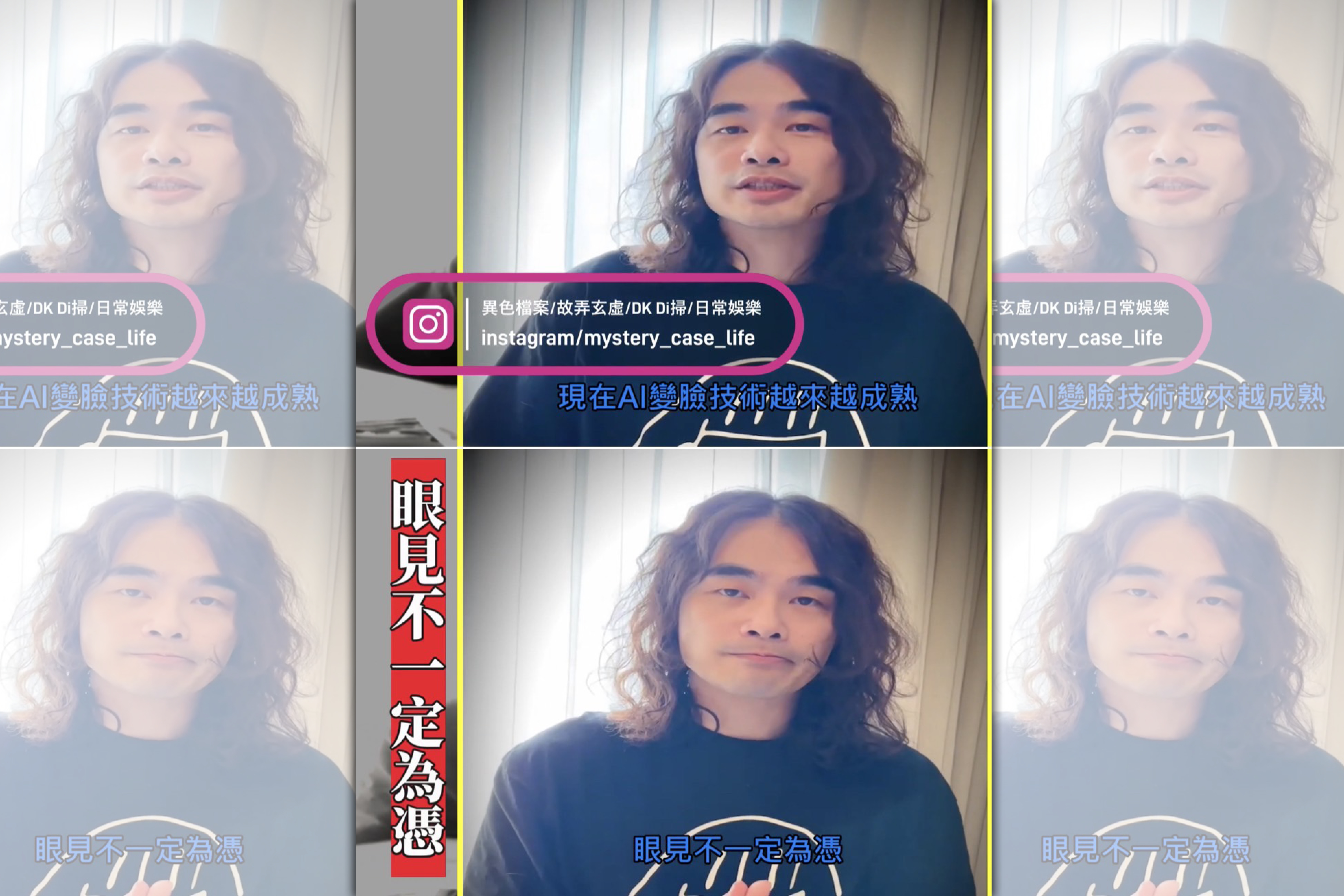

眼見不一定為憑,AI深偽(Deepfake)變臉技術,可以製造出逼真的虛假影像和聲音,仿真度極高,AI變臉軟體還內建許多來自不同人種的臉部圖片,甚至連名人、明星照片也有,且使用者可自由選擇性別及種族合成。從正面觀看以假亂真,很容易讓民眾誤以為是檢警或名人。

網紅「異色檔案」於影片中教導大家AI深偽詐騙手法的破解之道。在AI深偽的影像中,人的側臉、脖子等部位,現今軟體不會偵測分析及套用到,因此側面影像會產生模糊狀,臉部跟脖子也會產生色差,如果忽然有親友、同事要求視訊,或是生活中未見過的人、自稱檢警等單位視訊,且在通話中要求民眾匯錢,民眾可以要求對方轉頭、變換姿勢、在臉前揮手,就可以藉由影像破綻分辨出對方是否使用深偽AI技術變臉,避免受騙。除此之外,民眾也可以親友互相約定「通關密語」,進一步避免被騙。

中正二分局表示,未來與熟人視訊,或與未見過的人或自稱檢警等單位視訊,可要求對方轉頭、變換姿勢、在臉前揮手,就可藉由影像破綻分辨對方是否使用深偽AI技術變臉,千萬不要因為鏡頭的那端是熟人就信以為真,接獲各項影音訊息務必提高警覺,也謹記「談到錢要警覺、談借錢要查證、談投資金錢要當心」,發現深偽犯罪或遇有疑慮時,請打反詐專線165諮詢查證保護您的荷包。